Giới Thiệu

NVIDIA Hopper GPU mở rộng phạm vi khi nhu cầu về AI tăng cao

NVIDIA Hopper GPU H100 hiện được cung cấp bởi những gã khổng lồ trên nền tảng đám mây để đáp ứng nhu cầu ngày càng tăng về đào tạo và suy luận AI sáng tạo; Meta, OpenAI, AI đang ổn định để tận dụng H100 cho làn sóng AI tiếp theo

GTC— NVIDIA và các đối tác quan trọng hôm nay đã công bố sự sẵn có của các sản phẩm và dịch vụ mới có NVIDIA GPU H100 Tensor Core — GPU mạnh nhất thế giới dành cho AI — để giải quyết nhu cầu đào tạo và suy luận AI tổng quát ngày càng tăng.

Cụ thể, Oracle Cloud Infrastructure (OCI) thông báo về sự xuất hiện giới hạn của các trường hợp máy chủ OCI Compute bare-metal GPU mới có tính năng H100 GPU. Ngoài ra, Amazon Web Services cũng đã thông báo về các UltraCluster EC2 của Amazon EC2 P5, sẽ được trang bị tối đa 20.000 H100 GPU được kết nối với nhau. Điều này đến sau thông báo xem trước bản xem trước riêng tư của Microsoft Azure tuần trước cho máy ảo H100 của nó, ND H100 v5.

Ngoài ra, Meta hiện đã triển khai siêu máy tính AI Grand Teton được trang bị H100 cho các đội sản xuất và nghiên cứu của mình.

đã sử dụng tiền thân của H100 — GPU NVIDIA A100 — để đào tạo và chạy ChatGPT, một hệ thống AI được tối ưu hóa cho đối thoại, đã được hàng trăm triệu người trên toàn thế giới sử dụng trong thời gian kỷ lục. OpenAI sẽ sử dụng H100 trên siêu máy tính Azure của mình để cung cấp năng lượng cho nghiên cứu AI đang tiếp tục của mình

đã sử dụng tiền thân của H100 — GPU NVIDIA A100 — để đào tạo và chạy ChatGPT, một hệ thống AI được tối ưu hóa cho đối thoại, đã được hàng trăm triệu người trên toàn thế giới sử dụng trong thời gian kỷ lục. OpenAI sẽ sử dụng H100 trên siêu máy tính Azure của mình để cung cấp năng lượng cho nghiên cứu AI đang tiếp tục của mình

Siêu máy tính NVIDIA DGX H100 được sản xuất đầy đủ và có thể đặt hàng từ các đối tác NVIDIA trên toàn thế giới. Khách hàng có thể dùng thử DGX H100 ngay hôm nay với NVIDIA DGX Cloud .

NVIDIA Hopper GPU H100 trên đám mây hiện khả dụng từ Azure ở dạng xem trước riêng tư, Cơ sở hạ tầng đám mây Oracle ở dạng khả dụng hạn chế và thường khả dụng từ Cirrascale và CoreWeave . AWS đã công bố H100 sẽ có sẵn trong vài tuần tới dưới dạng bản xem trước có giới hạn. Google Cloud cùng với các đối tác đám mây của NVIDIA là Lambda , Paperspace và Vultr có kế hoạch cung cấp H100.

Máy chủ và hệ thống có NVIDIA Hopper GPU H100 có sẵn từ các nhà sản xuất máy chủ hàng đầu bao gồm Atos, Cisco, Dell Technologies, GIGABYTE, Hewlett Packard Enterprise, Lenovo và Supermicro.

NVIDIA Hopper GPU H100 là một sự đột phá lớn trong lĩnh vực AI và đang được cung cấp bởi các gã khổng lồ trên nền tảng đám mây. Oracle Cloud Infrastructure, Amazon Web Services và Microsoft Azure đã thông báo về sự sẵn có của H100 để đáp ứng nhu cầu ngày càng tăng về đào tạo và suy luận AI. Đồng thời, Meta đã triển khai siêu máy tính AI Grand Teton được trang bị H100 . Với kiến trúc Hopper và công cụ biến áp tích hợp, H100 đã được tối ưu hóa để phát triển, đào tạo và triển khai AI tổng quát, các mô hình ngôn ngữ lớn và hệ thống đề xuất.

NVIDIA DGX H100 cung cấp hiệu suất điện toán 32 petaflop ở độ chính xác FP8, giúp tối đa hóa hiệu quả năng lượng trong việc xử lý khối lượng công việc AI lớn. OpenAI là một trong những người tiên phong về AI áp dụng H100 để tăng tốc công việc của họ, đặc biệt là trong việc đào tạo và chạy ChatGPT.

Hiện tại maychuvina đang cung cấp các dòng GPU NVIDIA chính hãng với giá cạnh tranh.

Siêu máy tính NVIDIA DGX H100 được sản xuất đầy đủ và có thể đặt hàng từ các đối tác NVIDIA trên toàn thế giới. Khách hàng có thể dùng thử DGX H100 ngay hôm nay với NVIDIA DGX Cloud .

NVIDIA Hopper GPU H100 trên đám mây hiện khả dụng từ Azure ở dạng xem trước riêng tư, Cơ sở hạ tầng đám mây Oracle ở dạng khả dụng hạn chế và thường khả dụng từ Cirrascale và CoreWeave . AWS đã công bố H100 sẽ có sẵn trong vài tuần tới dưới dạng bản xem trước có giới hạn. Google Cloud cùng với các đối tác đám mây của NVIDIA là Lambda , Paperspace và Vultr có kế hoạch cung cấp H100.

Máy chủ và hệ thống có NVIDIA Hopper GPU H100 có sẵn từ các nhà sản xuất máy chủ hàng đầu bao gồm Atos, Cisco, Dell Technologies, GIGABYTE, Hewlett Packard Enterprise, Lenovo và Supermicro.

NVIDIA Hopper GPU H100 là một sự đột phá lớn trong lĩnh vực AI và đang được cung cấp bởi các gã khổng lồ trên nền tảng đám mây. Oracle Cloud Infrastructure, Amazon Web Services và Microsoft Azure đã thông báo về sự sẵn có của H100 để đáp ứng nhu cầu ngày càng tăng về đào tạo và suy luận AI. Đồng thời, Meta đã triển khai siêu máy tính AI Grand Teton được trang bị H100 . Với kiến trúc Hopper và công cụ biến áp tích hợp, H100 đã được tối ưu hóa để phát triển, đào tạo và triển khai AI tổng quát, các mô hình ngôn ngữ lớn và hệ thống đề xuất.

NVIDIA DGX H100 cung cấp hiệu suất điện toán 32 petaflop ở độ chính xác FP8, giúp tối đa hóa hiệu quả năng lượng trong việc xử lý khối lượng công việc AI lớn. OpenAI là một trong những người tiên phong về AI áp dụng H100 để tăng tốc công việc của họ, đặc biệt là trong việc đào tạo và chạy ChatGPT.

Hiện tại maychuvina đang cung cấp các dòng GPU NVIDIA chính hãng với giá cạnh tranh.

Kiến trúc Hopper tăng tốc AI

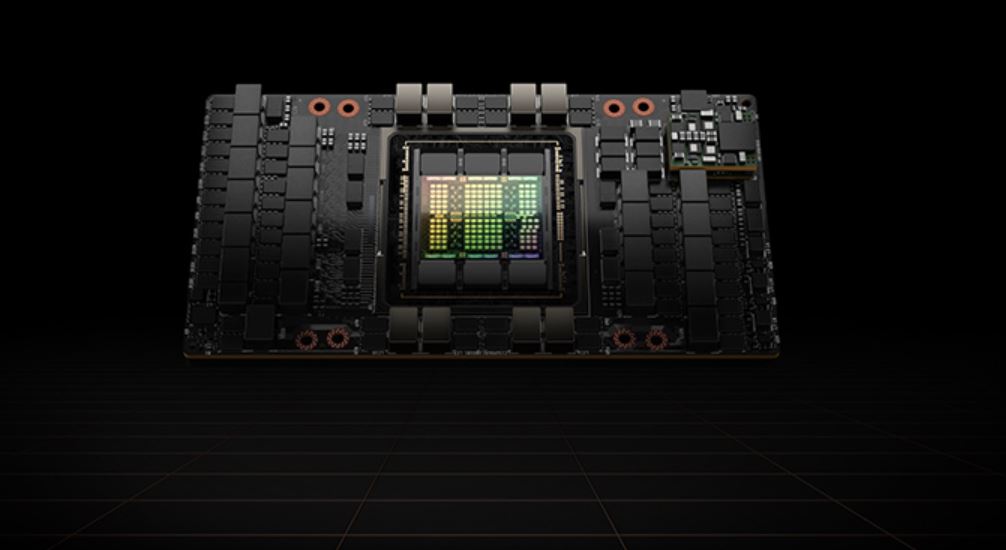

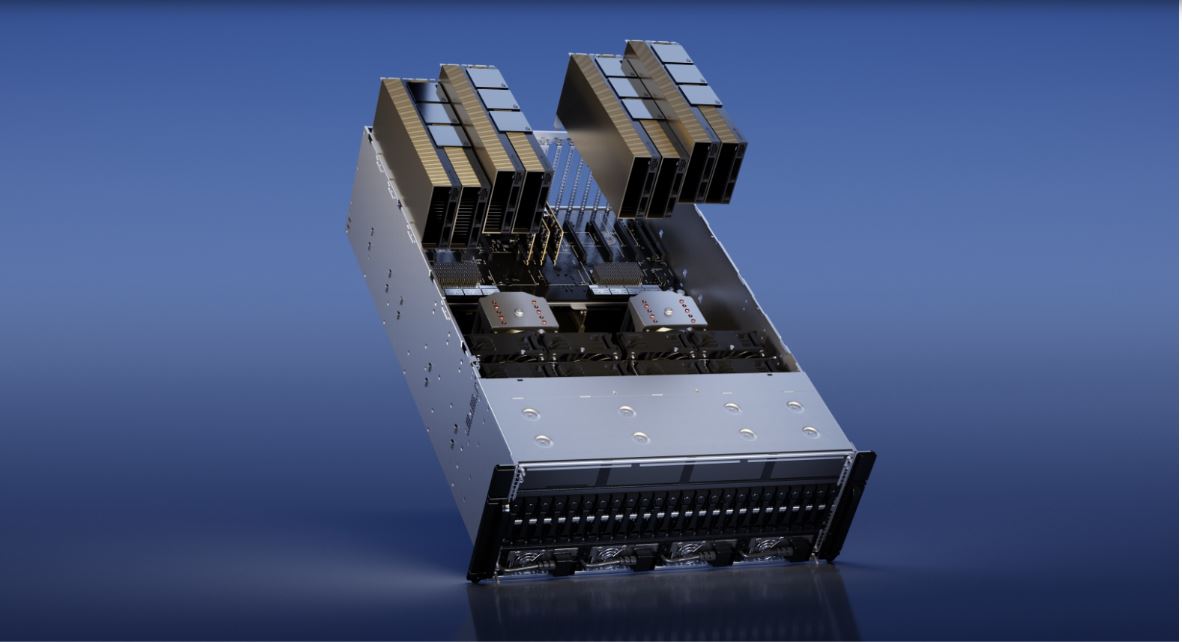

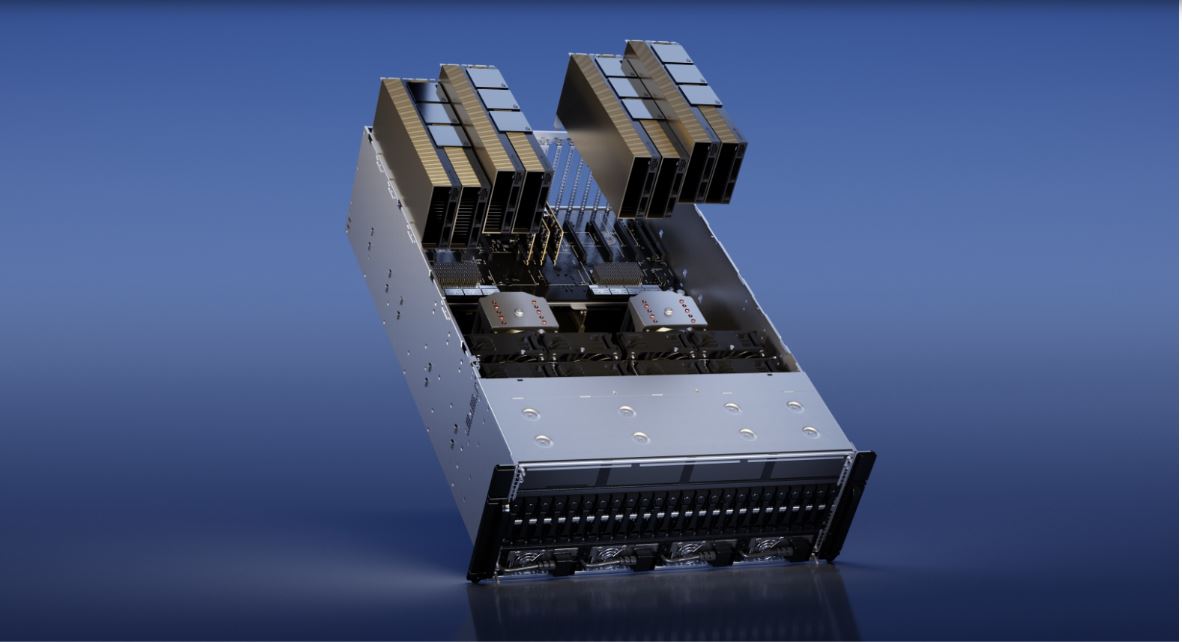

H100, dựa trên kiến trúc điện toán NVIDIA Hopper GPU ,với Công cụ biến áp tích hợp, được tối ưu hóa để phát triển, đào tạo và triển khai AI tổng quát, các mô hình ngôn ngữ lớn (LLM) và hệ thống đề xuất. Công nghệ này sử dụng độ chính xác FP8 của H100 và cung cấp đào tạo AI nhanh hơn 9 lần và suy luận AI nhanh hơn tới 30 lần trên LLM so với A100 thế hệ trước. H100 bắt đầu được vận chuyển vào mùa thu theo đơn vị bo mạch riêng lẻ và chọn lọc từ các nhà sản xuất toàn cầu. NVIDIA DGX H100 có tám GPU H100 được kết nối với kết nối tốc độ cao NVIDIA NVLink® và tích hợp mạng NVIDIA Quantum InfiniBand và Spectrum™ Ethernet. Nền tảng này cung cấp 32 petaflop hiệu suất điện toán ở độ chính xác FP8, với kết nối mạng nhanh hơn gấp 2 lần so với thế hệ trước, giúp tối đa hóa hiệu quả năng lượng trong việc xử lý khối lượng công việc AI lớn. DGX H100 cũng có ngăn xếp phần mềm NVIDIA AI hoàn chỉnh, cho phép các doanh nghiệp chạy và quản lý khối lượng công việc AI của họ một cách liền mạch trên quy mô lớn. Ưu đãi này bao gồm phiên bản mới nhất của NVIDIA AI Enterprise , hệ điều hành của trung tâm dữ liệu DGX, hệ thống điều phối hoạt động và đào tạo AI trên nền tảng NVIDIA DGX để đơn giản hóa và hợp lý hóa quá trình phát triển AI.Những người tiên phong về AI áp dụng H100

Một số người tiên phong về AI tổng quát đang áp dụng H100 để tăng tốc công việc của họ:OpenAI

đã sử dụng tiền thân của H100 — GPU NVIDIA A100 — để đào tạo và chạy ChatGPT, một hệ thống AI được tối ưu hóa cho đối thoại, đã được hàng trăm triệu người trên toàn thế giới sử dụng trong thời gian kỷ lục. OpenAI sẽ sử dụng H100 trên siêu máy tính Azure của mình để cung cấp năng lượng cho nghiên cứu AI đang tiếp tục của mình

đã sử dụng tiền thân của H100 — GPU NVIDIA A100 — để đào tạo và chạy ChatGPT, một hệ thống AI được tối ưu hóa cho đối thoại, đã được hàng trăm triệu người trên toàn thế giới sử dụng trong thời gian kỷ lục. OpenAI sẽ sử dụng H100 trên siêu máy tính Azure của mình để cung cấp năng lượng cho nghiên cứu AI đang tiếp tục của mình

Meta

một đối tác công nghệ quan trọng của NVIDIA, đã phát triển hệ thống siêu máy tính AI dựa trên Hopper Grand Teton với nhiều cải tiến về hiệu suất so với người tiền nhiệm Zion, bao gồm gấp 4 lần băng thông từ máy chủ đến GPU, gấp 2 lần băng thông mạng tính toán và dữ liệu và gấp 2 lần băng thông máy chủ. phong bì quyền lực. Với khả năng tính toán lớn hơn này, Grand Teton có thể hỗ trợ cả quá trình đào tạo và suy luận sản xuất các mô hình đề xuất học sâu và hiểu nội dung.Stability AI

Công ty tiên phong trong lĩnh vực AI tạo văn bản thành hình ảnh, là khách hàng truy cập sớm H100 trên AWS. Ổn định AI có kế hoạch sử dụng H100 để tăng tốc các mô hình video, 3D và đa phương thức sắp tới của mình.Twelve Labs

Một nền tảng cung cấp cho các doanh nghiệp và nhà phát triển khả năng hiểu video đa phương thức, có kế hoạch sử dụng các phiên bản H100 trên một Siêu cụm OCI để tạo video ngay lập tức, thông minh và dễ dàng tìm kiếm.Anlatan

Người tạo ra ứng dụng NovelAI để viết truyện và tổng hợp văn bản thành hình ảnh được hỗ trợ bởi AI, đang sử dụng các phiên bản H100 trên nền tảng đám mây của CoreWeave để tạo và suy luận mô hình.DGX H100 trên toàn thế giới

Các nhà đổi mới trên toàn thế giới đang nhận được làn sóng đầu tiên của các hệ thống DGX H100, bao gồm:- CyberAgent , một công ty dịch vụ internet và quảng cáo kỹ thuật số hàng đầu có trụ sở tại Nhật Bản, đang tạo quảng cáo kỹ thuật số do AI sản xuất và hình đại diện song sinh kỹ thuật số của người nổi tiếng, hoàn toàn sử dụng công nghệ AI và LLM tổng quát.

- Viện Công nghệ Hoàng gia KTH , một trường đại học kỹ thuật và kỹ thuật hàng đầu châu Âu có trụ sở tại Stockholm, sẽ sử dụng DGX H100 để cung cấp các chương trình khoa học máy tính tiên tiến nhất cho giáo dục đại học.

- Mitsui, một trong những tập đoàn kinh doanh hàng đầu của Nhật Bản, có nhiều hoạt động kinh doanh trong các lĩnh vực như năng lượng, chăm sóc sức khỏe, CNTT và truyền thông, đang xây dựng siêu máy tính AI thế hệ thứ nhất của Nhật Bản để khám phá thuốc, được cung cấp bởi DGX H100.

- Telconet : nhà cung cấp dịch vụ viễn thông hàng đầu ở Ecuador, đang xây dựng các phân tích video thông minh cho các thành phố an toàn và dịch vụ ngôn ngữ để hỗ trợ khách hàng sử dụng các phương ngữ tiếng Tây Ban Nha.

Tính khả dụng

Siêu máy tính NVIDIA DGX H100 được sản xuất đầy đủ và có thể đặt hàng từ các đối tác NVIDIA trên toàn thế giới. Khách hàng có thể dùng thử DGX H100 ngay hôm nay với NVIDIA DGX Cloud .

NVIDIA Hopper GPU H100 trên đám mây hiện khả dụng từ Azure ở dạng xem trước riêng tư, Cơ sở hạ tầng đám mây Oracle ở dạng khả dụng hạn chế và thường khả dụng từ Cirrascale và CoreWeave . AWS đã công bố H100 sẽ có sẵn trong vài tuần tới dưới dạng bản xem trước có giới hạn. Google Cloud cùng với các đối tác đám mây của NVIDIA là Lambda , Paperspace và Vultr có kế hoạch cung cấp H100.

Máy chủ và hệ thống có NVIDIA Hopper GPU H100 có sẵn từ các nhà sản xuất máy chủ hàng đầu bao gồm Atos, Cisco, Dell Technologies, GIGABYTE, Hewlett Packard Enterprise, Lenovo và Supermicro.

Siêu máy tính NVIDIA DGX H100 được sản xuất đầy đủ và có thể đặt hàng từ các đối tác NVIDIA trên toàn thế giới. Khách hàng có thể dùng thử DGX H100 ngay hôm nay với NVIDIA DGX Cloud .

NVIDIA Hopper GPU H100 trên đám mây hiện khả dụng từ Azure ở dạng xem trước riêng tư, Cơ sở hạ tầng đám mây Oracle ở dạng khả dụng hạn chế và thường khả dụng từ Cirrascale và CoreWeave . AWS đã công bố H100 sẽ có sẵn trong vài tuần tới dưới dạng bản xem trước có giới hạn. Google Cloud cùng với các đối tác đám mây của NVIDIA là Lambda , Paperspace và Vultr có kế hoạch cung cấp H100.

Máy chủ và hệ thống có NVIDIA Hopper GPU H100 có sẵn từ các nhà sản xuất máy chủ hàng đầu bao gồm Atos, Cisco, Dell Technologies, GIGABYTE, Hewlett Packard Enterprise, Lenovo và Supermicro.