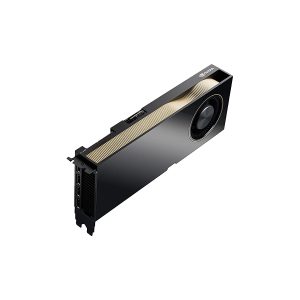

GPU NVIDIA A100 Tensor Core 80GB CoWoS HBM2e PCIe 4.0

649.890.000₫

Giá chưa bao gồm 8% VAT

- Nhà sản xuất: NVIDIA

- FP64: 9.7 TFLOPS

- FP64 Tensor Core: 19.5 TFLOPS

- FP32: 19.5 TFLOPS

- GPU Memory: 80GB HBM2e

- TDP: 300W

NVIDIA A100 – Mở ra thế giới dành cho AI

GPU NVIDIA A100 Tensor Core mang đến khả năng tăng tốc vô song ở mọi quy mô, đặc biệt là trong việc cung cấp năng lượng cho các trung tâm dữ liệu đàn hồi với hiệu suất AI, phân tích dữ liệu và HPC hàng đầu trên thế giới. Được kế thừa từ Kiến trúc NVIDIA Ampere, A100 không chỉ là một sản phẩm mà là trụ cột của nền tảng trung tâm dữ liệu NVIDIA.

Với hiệu suất vượt trội, A100 có khả năng tăng cường lên đến 20 lần so với thế hệ trước, đồng thời có khả năng linh hoạt thông qua việc chia thành bảy phiên bản GPU khác nhau, đáp ứng linh hoạt theo nhu cầu cụ thể. Phiên bản A100 80GB đưa đến trải nghiệm băng thông bộ nhớ nhanh nhất thế giới, với hơn 2 terabyte mỗi giây (TB/s), làm cho việc chạy các mô hình và xử lý bộ dữ liệu lớn trở nên hiệu quả và mạnh mẽ hơn bao giờ hết.

Thông số kỹ thuật GPU NVIDIA A100 80GB COWOS HBM2E PCIE 4.0

| Specifications GPU NVIDIA A100 80GB HBM2e PCIe 4.0 | ||

|---|---|---|

| FP64 | 9.7 TFLOPS | |

| FP64 Tensor Cors | 19.5 TFLOPS | |

| FP32 | 19.5 TFLOPS | |

| Tensor Float 32 (TF32) | 156 TFLOPS | |

| BFLOAT16 Tensor Core | 312 TFLOPS | |

| FP16 Tensor Core | 312 TFLOPS | |

| INT8 Tensor Core | 624 TOPS | |

| GPU Memory | 80GB HBM2e | |

| GPU Memory Bandwidth | 1,935GB/s | |

| Max Thermal Design Power(TDP) | 300W | |

| Multi-Instance GPU | Up to 7 MIGs @ 10GB | |

| Form Factor | PCIe(dual-slot air cooled or single-slot liquid cooled) | |

| Interconnect |

|

|

| Server Options | Partner and NVIDIACertified Systems™ with 1-8 GPUs | |

Thông tin liên hệ

SERVER VIỆT NAM – CAM KẾT UY TÍN & CHẤT LƯỢNG

- Mọi thắc mắc về sản phẩm Quý khách hàng vui lòng liên hệ:

- Hotline: 0972 710 812

- Website: https://www.maychuvina.com

- Facebook: https://www.facebook.com/maychuvina

- Địa chỉ: 110/20/41 Đường số 30, Phường 6, Gò vấp, TP.HCM

THÔNG SỐ KỸ THUẬT GPU NVIDIA A100 80GB COWOS HBM2e

| Card màn hình NVIDIA A100 Tensor Core GPU 80GB HBM2e | ||

|---|---|---|

| Model | A100 80GB PCIe | A100 80GB SXM |

| GPU Architecture | NVIDIA Ampere | |

| FP64 | 9.7 TFLOPS | |

| FP64 Tensor Cors | 19.5 TFLOPS | |

| FP32 | 19.5 TFLOPS | |

| Tensor Float 32 (TF32) | 156 TFLOPS | 312 TFLOPS |

| BFLOAT16 Tensor Core | 312 TFLOPS | 624 TFLOPS |

| FP16 Tensor Core | 312 TFLOPS | 624 TFLOPS |

| INT8 Tensor Core | 624 TOPS | 1248 TOPS |

| GPU Memory | 80GB HBM2e | 80GB HBM2e |

| GPU Memory Bandwidth | 1,935GB/s | 2,039GB/s |

| Max Thermal Design Power(TDP) | 300W | 400W |

| Multi-Instance GPU | Up to 7 MIGs @ 10GB | Up to 7 MIGs @ 10GB |

| Form Factor | PCIe(dual-slot air cooled or single-slot liquid cooled) | SXM |

| Interconnect |

|

|

| Server Options | Partner and NVIDIACertified Systems™ with 1-8 GPUs |

|

Đánh giá

There are no reviews yet